Chat with RTX现已开放免费下载,这是一款技术演示应用,用户可以使用自己的内容来个性化聊天机器人。在NVIDIA GeForce RTX 30系列GPU(或更高性能版本,至少8GB显存)的支持下,Chat with RTX可提供极速的体验。

也就是说,Chat with RTX 无需依赖基于云服务的大型语言模型(LLM),它让用户可以在不向第三方共享数据、甚至无需网络连接的情况下在本地电脑处理敏感数据。

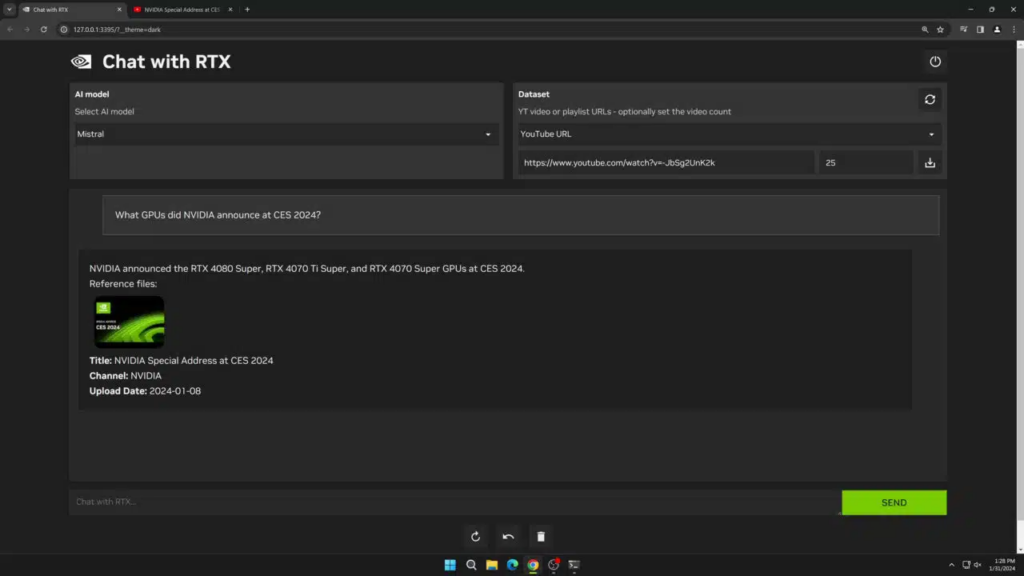

Chat with RTX 结合了检索增强生成 (RAG)、NVIDIA TensorRT-LLM 软件和 NVIDIA RTX 加速技术,将生成式人工智能功能带到由 GeForce 支持的本地 Windows 电脑上。用户可以快速、轻松地将本地PC上的文件作为数据集去链接到开源的大型语言模型(如 Mistral 或 Llama 2),从而支持相关查询,以获得快速、上下文相关的答案。

Chat with RTX支持多种文件格式,包括 .txt、.pdf、.doc/.docx 和 .xml。只需指定包含这些文件的文件夹,该工具就能在几秒钟内将它们载入到程序库中。

另外,用户还可以添加来自 YouTube 视频和播放列表的信息。将视频链接加入 Chat with RTX 后,用户就可以将这些知识集成到他们的聊天机器人中,用于关联性的问题查询。你可以根据喜爱的网红视频来询问旅行建议,或者根据热门的教育视频快速获取教程和指南。

除了需要 NVIDIA GeForce RTX 30 系列 (或更高性能版本) GPU 和 最少8GB 显存外,Chat with RTX还需要 Windows 10 或 Windows 11 系统以及最新的 NVIDIA GPU 驱动程序。

然而,根据官方文档,Chat with RTX目前存在着一个安装问题,即当用户选择自定义安装目录时,安装会导致失败。此问题将在后续的版本中得到修复。用户暂时应使用默认安装路径 (“C:\Users\<username>\AppData\Local\NVIDIA\ChatWithRTX”)。

目前,Chat with RTX项目源代码可在 GitHub 上获取。

主要关键点:

现在,您可以利用Chat with RTX 创建一个完全属于您自己的专属知识库,快速分析您提供的大量数据,包括:

- 研究论文和技术文档: 让科研、工程、医疗等领域的专业人士能随时查询高度专业化的内容。

- 公司内部资料: 构建可搜索的内部资料库,优化培训流程与企业知识库管理。

- 个人创作库: 作家、编剧能轻松索引自己的剧本、笔记,甚至聊天记录,获得更流畅的创作体验。

Chat with RTX的优势

- 确保数据安全: 您的敏感数据始终保留在本地设备上,无需外传至云端,最大程度确保用户信息与知识产权的保密性。

- 定制化回答: Chat with RTX 不是泛泛地从互联网撷取信息,而是完全基于您提供的数据集生成回应。

- 离线工作模式: 即使没有网络连接,依然能够使用 Chat with RTX。这在网络不稳定或受限的环境中提供了可靠性。

- 快速且高效: 由NVIDIA RTX GPU的强大性能驱动,Chat with RTX 能带来近乎实时的搜索、问答体验。

技术细节

Chat with RTX 基于 NVIDIA 的 Megatron-Turing NLG 530B 模型,该模型拥有5300亿个参数,是目前世界上最大的语言模型之一。它采用了检索增强生成(RAG)技术,能够将来自您提供的数据与互联网上的公开信息进行整合,提供更加全面、准确的回答。

系统要求

要使用 Chat with RTX,您需要满足以下系统要求:

- 操作系统:Windows 11

- 显示卡:NVIDIA GeForce RTX 30 或 40 系列显卡,至少 8GB 显存

- 内存:16GB 或更高

- 存储空间:60GB 或更高

- 显卡驱动程序版本:535.11 或更高

如何开始

您可以按照以下步骤开始使用 Chat with RTX:

- 下载并安装 Chat with RTX 应用

- 准备您的数据集。您可以将文本文件、PDF 文件、视频文件等添加到您的数据集

- 启动 Chat with RTX 应用,并选择您要使用的数据集

- 输入您的问题或指令,Chat with RTX 将会为您提供相应的回答或结果

一些使用技巧

- 为了获得最佳效果,请尽可能提供更多的数据。

- 您可以使用自然语言进行提问或指令,例如“告诉我有关中国历史的知识”或“帮我写一首关于爱情的诗”。

- Chat with RTX 仍在开发中,如果您遇到任何问题或错误,请随时反馈给 NVIDIA。

操作系统要求:

目前,按照官方信息,Chat with RTX 主要安装在 Windows 11 操作系统。

主要原因如下:

- Windows 11 引入了新的 DirectStorage API,可以显著提高 GPU 对存储资源的访问速度,这对于 Chat with RTX 这种需要大量数据处理的应用来说至关重要。

- Windows 11 还包含了一些针对 AI 和机器学习的优化,可以提升 Chat with RTX 的性能表现。

如果您想要在 Windows 10 上使用 Chat with RTX,可以尝试以下方法:

- 安装 Windows 11 预览版:您可以通过微软官网下载 Windows 11 预览版,但需要注意的是预览版可能存在一些不稳定性。

- 使用虚拟机:您可以安装虚拟机软件,例如 VMware 或 VirtualBox,并在虚拟机中安装 Windows 11 和 Chat with RTX。

但是,请注意这两种方法都存在一些局限性:

- Windows 11 预览版可能不适合日常使用,并且存在一些兼容性问题。

- 使用虚拟机可能会降低 Chat with RTX 的性能表现。

因此,如果您想要获得最佳体验,建议您在 Windows 11 正式版发布后再使用 Chat with RTX。

原创文章,如若转载,请注明出处。